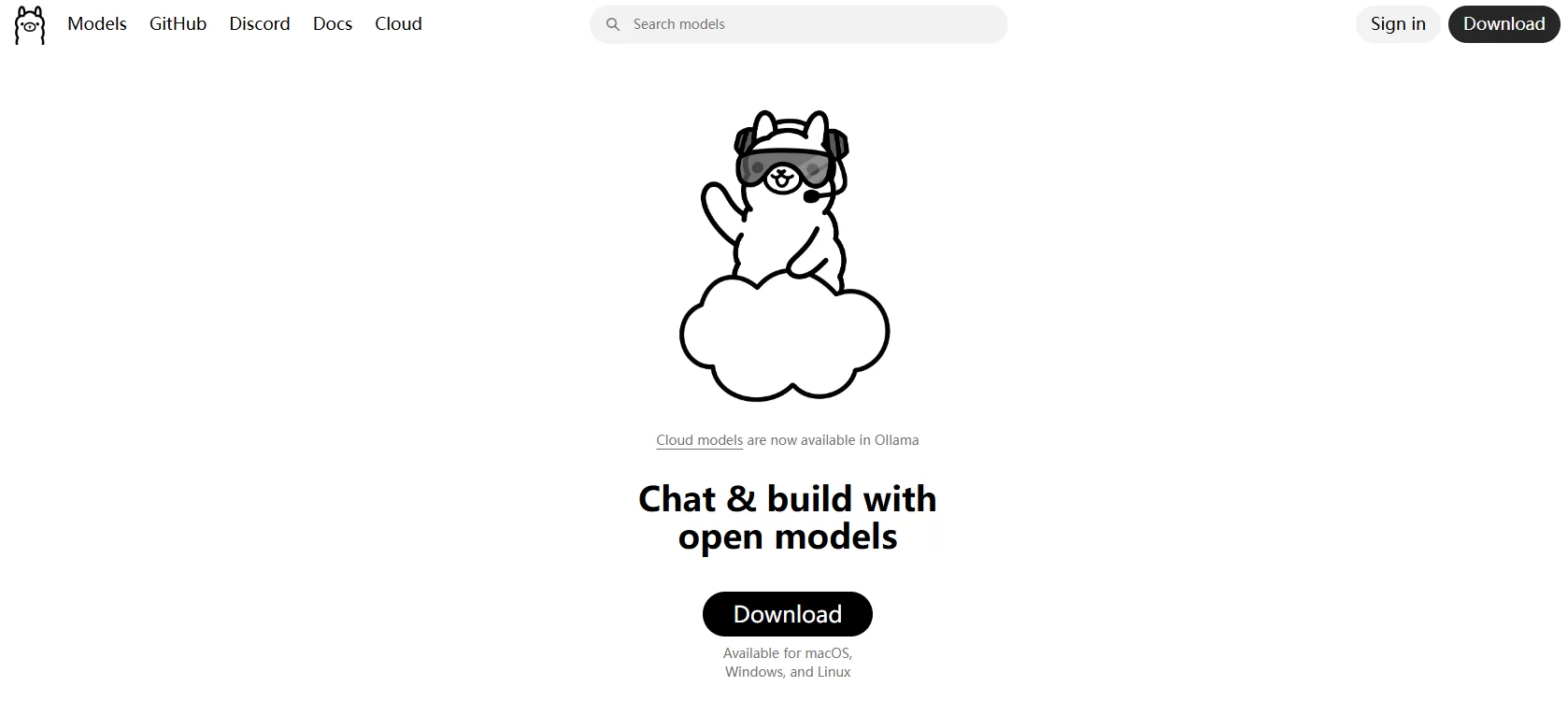

Ollama是什么?

Ollama是一款前沿的AI应用,它让用户能够轻松在自己的设备上部署和操作大型语言模型(LLMs),目前主要支持macOS和Linux系统,Windows版本也即将推出。这款工具的一大特色在于,它不仅能够运行Llama 2等高性能语言模型,还支持用户自主设计和开发专属模型。

Ollama官方网站:https://ollama.ai/

GitHub代码库:https://github.com/jmorganca/ollama

Ollama主要功能

- 本地模型运行:Ollama支持用户在本地环境执行大型语言模型,从而获得更快速、更高效的运算体验。

- Llama 2支持:用户可以选用Llama 2语言模型,该模型具备先进的自然语言处理能力,适用于多种应用场景。

- 模型个性化定制:Ollama允许用户针对特定需求调整和构建自己的语言模型。

- 便捷部署:该应用提供直观的用户界面,帮助用户快速启动并运行所选的语言模型。

- 跨平台兼容:目前Ollama已支持macOS系统,确保与macOS设备的完美适配。

如何使用Ollama?

想要体验Ollama,用户首先需要前往官方网站获取并安装该工具。安装完成后,用户既可以使用内置的语言模型,也可以根据需求进行模型的自定义或创建。Ollama极大地简化了本地语言模型的运行流程,为用户在AI领域提供了更高的控制权和灵活性。无论是科研人员、技术开发者还是数据分析专家,Ollama都能帮助他们在AI应用方面实现突破,将技术实践提升至全新高度。

Ollama可用的模型

Ollama提供了丰富的模型选择,包括但不限于下表所列的各类模型: 探索更多可用模型:https://ollama.ai/library

| Model | Parameters | Size | Download |

|---|---|---|---|

| Neural Chat | 7B | 4.1GB | ollama run neural-chat |

| Starling | 7B | 4.1GB | ollama run starling-lm |

| Mistral | 7B | 4.1GB | ollama run mistral |

| Llama 2 | 7B | 3.8GB | ollama run llama2 |

| Code Llama | 7B | 3.8GB | ollama run codellama |

| Llama 2 Uncensored | 7B | 3.8GB | ollama run llama2-uncensored |

| Llama 2 13B | 13B | 7.3GB | ollama run llama2:13b |

| Llama 2 70B | 70B | 39GB | ollama run llama2:70b |

| Orca Mini | 3B | 1.9GB | ollama run orca-mini |

| Vicuna | 7B | 3.8GB | ollama run vicuna |

| LLaVA | 7B | 4.5GB | ollama run llava |

总而言之,Ollama是一款功能强大的应用,特别适合那些希望在本地环境中探索和运用大型语言模型的用户,尤其是对AI技术有浓厚兴趣和特定需求的从业者。

评论 ( 0 )