一、AudioGPT是什么?

AudioGPT是一款能够理解并生成语音、音乐及各类声音的多模态人工智能系统,通过融合Chat-GPT与音频基础模型,实现了对复杂音频信息的处理和口头对话支持,在多轮交互中展现出卓越的音频解析与创作能力,让用户能够便捷地构建多样化的音频作品。

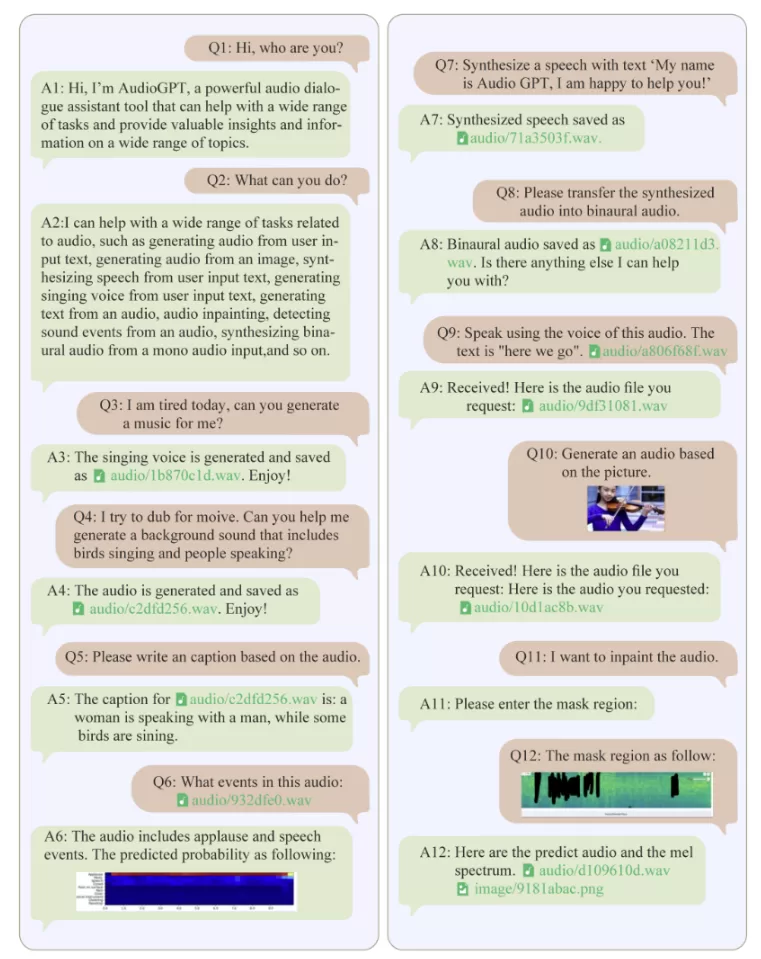

这项创新的音频理解与生成技术由浙江大学、北京大学、卡内基梅隆大学和中国人民大学的研究团队共同研发完成。 AudioGPT以Chat-GPT作为核心的对话控制单元,配合语音基础模型完成跨模态信息转换,同时具备对音频(含语音、音乐、环境音、3D声源定位)等多模态信息的理解与生成能力,可胜任20余种涉及多语言、多模态的AI音频应用场景。 功能展示:

二、AudioGPT可以做什么?

该系统还支持多种实用功能,例如:

- 音频转文字功能;

- 从图像中提取音乐与声音元素;

- 根据音频文件生成人物口型视频

三、工作流程

AudioGPT的运行包含四个关键环节:

- 模态转换:运用语音识别技术将语音指令转化为文本数据;

- 任务分析:借助Chat-GPT解析用户的具体需求;

- 模型匹配:从包含17种专业模型的库中筛选最适配当前任务的AI算法;

- 响应生成:采用音频、文本、图像或视频等多种形式输出结果并呈现给用户

四、AudioGPT局限性

尽管AudioGPT功能强大,但仍存在一些待改进之处:

- 系统并非专为音乐创作设计;

- 在任务分配和用户意图理解方面尚有优化空间

对音乐制作的影响 以AudioGPT为代表的AI音乐创作辅助工具,有望从根本上重塑音乐人的工作模式。通过扩展音乐模型功能或建立独立的MusicGPT系统,并开发可嵌入数字音频工作站(DAW)的插件,这类AI音频工具可能成为音乐人的重要创作资源,既不会削弱人类在音乐制作中的创造性与表现力,反而能提供强大的技术支持。

五、如何使用?

- 模型体验:https://huggingface.co/spaces/AIGC-Audio/AudioGPT

- 项目源码:https://github.com/AIGC-Audio/AudioGPT

- 研究论文:https://arxiv.org/abs/2304.12995

该模型目前仅支持非商业用途使用。

评论 ( 0 )