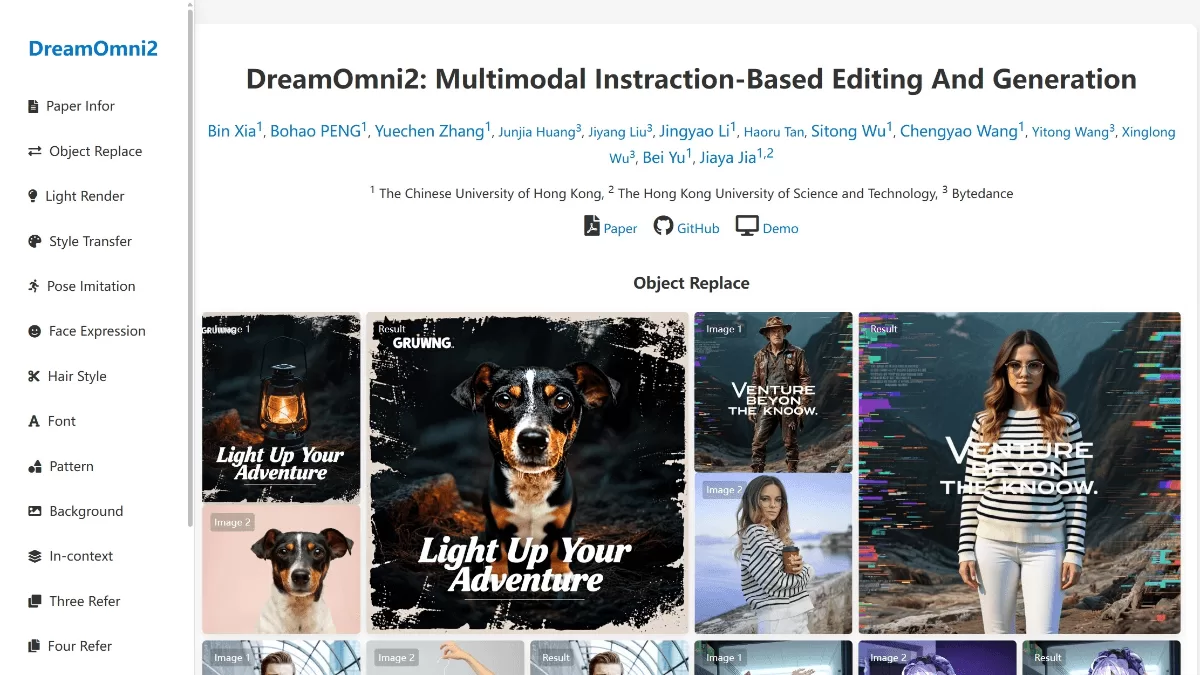

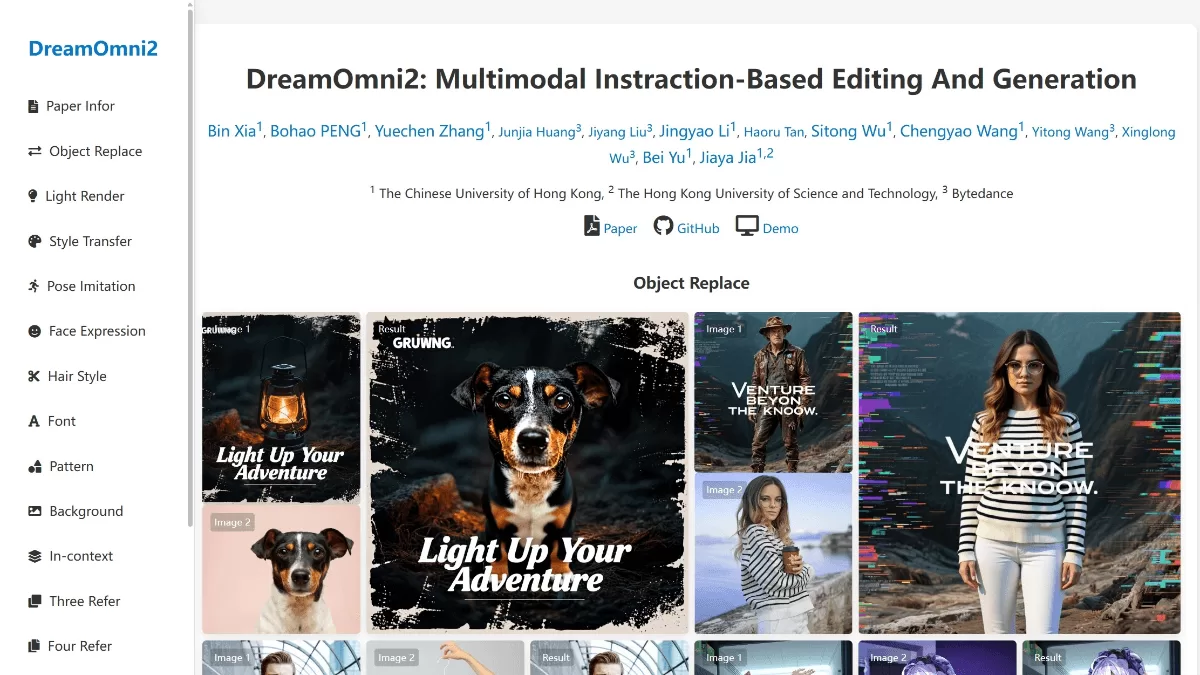

DreamOmni2是什么

DreamOmni2是由香港科技大学贾佳亚团队开发并开源的一款多模态人工智能图像编辑与生成工具。该模型能够同时解析文本和图像形式的指令,并支持使用多张参考图片,从而为创作者提供更为灵活的创作途径。模型通过三阶段的合成数据进行训练,将生成/编辑模型与视觉语言模型结合,有效保障了图像主体特征的稳定性。DreamOmni2在多模态指令编辑和生成领域表现出色,不仅优于现有的开源模型,在部分性能指标上甚至达到了商业级模型的水平。其应用范围广泛,涵盖产品摄影、设计流程、肖像处理以及创意绘画等多个领域。

DreamOmni2的功能特色

-

多模态指令支持:兼容文本和图像两种输入方式,可同时处理具体物体和抽象概念,如材质、纹理、风格等,为创作者提供更丰富的表达选择。

-

多参考图功能:能够整合多张参考图像进行编辑和生成,为创作者提供更高的创作自由度,满足复杂多样的创作需求。

-

创新训练流程:采用三阶段数据合成方法,包含特征混合技术、编辑与提取模型生成训练数据,并设计了索引编码和位置编码偏移方案,有效防止多图像输入时的像素混淆,显著提升模型的训练成效和生成品质。

-

联合训练机制:将生成/编辑模型与视觉语言模型(VLM)同步训练,使模型能更精准地理解并执行用户的多模态指令。

-

主体特征保持:在编辑过程中,能有效维持图像主体的身份特征,确保编辑后的图像与原主体保持高度一致,避免因编辑导致的主体特征缺失或变形。

-

领先性能表现:在多模态指令编辑与生成任务中,DreamOmni2显著超越当前SOTA开源模型,甚至在某些方面媲美或超越了商业级模型,为用户提供更优质的图像编辑和生成体验。

-

开放获取:代码、模型参数和训练数据集可在GitHub和Hugging Face平台免费获取,支持本地运行,用户只需配备足够显存的CUDA兼容GPU即可进行本地推理,大幅降低了使用门槛,提升了模型的普及度。

DreamOmni2的核心优势

-

多模态指令解析:能同时处理文本和图像指令,精准理解和执行复杂的编辑任务,如材质、纹理、风格等抽象概念的调整。

-

多参考图支持:可结合多张参考图进行编辑和生成,为创作者提供更高的创作灵活性,满足多样化创作需求。

-

主体特征一致性:在编辑过程中,有效保持图像主体的身份特征,确保编辑后的图像与原主体高度一致,避免主体特征丢失或混淆。

-

联合训练机制:将生成/编辑模型与视觉语言模型联合训练,提升对复杂指令的理解和执行能力,生成更符合用户意图的图像。

-

卓越性能:在多模态指令编辑与生成任务中,性能显著优于当前开源模型,甚至在某些方面超越商业模型,提供高质量的图像编辑和生成效果。

DreamOmni2官网是什么

- 项目官网:https://pbihao.github.io/projects/DreamOmni2/index.html

- Github仓库:https://github.com/dvlab-research/DreamOmni2

- arXiv技术论文:https://arxiv.org/pdf/2510.06679

- 体验地址:https://huggingface.co/spaces/wcy1122/DreamOmni2-Gen

DreamOmni2的适用人群

-

创意设计师:能快速实现设计构想,生成多种风格的设计稿,显著提升工作效率。

-

摄影师:用于产品摄影后期处理,增强产品视觉效果,满足不同客户的需求。

-

艺术家:快速创作绘画作品,探索不同风格和创意,激发艺术灵感。

-

广告从业者:快速生成广告素材,满足不同广告主题和风格的要求。

-

个人创作者:轻松实现创意构想,制作个性化的图像内容,满足个人创作需求。

©版权声明:如无特殊说明,本站所有内容均为Amassai.net 原创发布和所有。任何个人或组织,在未征得本站同意时,禁止复制、盗用、采集、发布本站内容到任何网站、书籍等各类媒体平台。否则,我站将依法保留追究相关法律责任的权利。

评论 ( 0 )